直近1週間の更新

6/10 (水)

Claude Code と Codex のレート残量を確認するためにブラウザを開くのをやめた話  生成AIタグが付けられた新着記事 - Qiita

生成AIタグが付けられた新着記事 - Qiita

はじめにClaude Code と Codex を Pro / Plus プランで併用していると、レートリミット(5時間枠・週枠)にそれなりの頻度で当たります。当たると作業が止まるので、私は枠に当たらないように Codex と Claude を切り替えたり、モデルを切り...

3分前

AIが、開発者に聞く ── R.E.V.I.S. #15 「全文は、読めない」  生成AIタグが付けられた新着記事 - Qiita

生成AIタグが付けられた新着記事 - Qiita

コードを渡されて Claude が質問し、開発者本人(eNIGM4 / 株式会社メイビス)が答えていく連載の第15回です。前回(#14)は、v0.3.1 で「賢く、やらない」── 重い処理の手前に審査の関所を置く思想が結晶した版でした。手持ちで足りるなら通さない、足りない時...

3分前

AIが、開発者に聞く ── R.E.V.I.S. #15 「全文は、読めない」  LLMタグが付けられた新着記事 - Qiita

LLMタグが付けられた新着記事 - Qiita

コードを渡されて Claude が質問し、開発者本人(eNIGM4 / 株式会社メイビス)が答えていく連載の第15回です。前回(#14)は、v0.3.1 で「賢く、やらない」── 重い処理の手前に審査の関所を置く思想が結晶した版でした。手持ちで足りるなら通さない、足りない時...

3分前

Claude Code v2.1.169〜v2.1.170 リリース|毎日Changelog解説  AIタグが付けられた新着記事 - Qiita

AIタグが付けられた新着記事 - Qiita

Claude Codeの公式Changelogをリリースから最速で翻訳・解説しています。v2.1.169〜v2.1.170 の計 2 本を 1 本にまとめます。v2.1.170 で新モデル Claude Fable 5 が一般公開、v2.1.169 は機能追加と修...

5分前

AI Engineering Summit Tokyo 2026(2日目)セッションレポート — モデルの使い分けから「構造で守る運用」「ガバナンス基盤」、そしてAI駆動開発の「文化」へ  AIタグが付けられた新着記事 - Qiita

AIタグが付けられた新着記事 - Qiita

グラレコAI Engineering Summit Tokyo 2026(Summer)の はじめに 🎯2 日目(2026/06/09)に聴講した 7 セッションのレポートです。1 日目が「AI で作れることは前提になり、論点は運用・統制へ移っている」という大きな...

16分前

Google動画生成モデル3つを定性比較してみた(Veo 3.1 Quality / Fast / Omni Flash)  生成AIタグが付けられた新着記事 - Qiita

生成AIタグが付けられた新着記事 - Qiita

はじめにこんにちは!Yumekawa-chanです。私はこの半年間、Google AI Ultraプラン(月36,000円)に課金して、Googleの動画生成AIモデルのVeoで動画を作り続けてきました。生成した動画はトータルで数千本にのぼり、恐らく日本でもVeoを触...

40分前

AIに何ができないかを理解していないと、DXは進まない  AIタグが付けられた新着記事 - Qiita

AIタグが付けられた新着記事 - Qiita

はじめに最近、「AIが仕事を奪う」という話をよく耳にします。実際、生成AIの進化は非常に速く、コード生成統計解析レポート作成データ分析など、多くの業務を支援できるようになりました。私自身、20年以上メカ設計に携わった後、品質部門へ異動し、Pytho...

1時間前

AIに何ができないかを理解していないと、DXは進まない  機械学習タグが付けられた新着記事 - Qiita

機械学習タグが付けられた新着記事 - Qiita

はじめに最近、「AIが仕事を奪う」という話をよく耳にします。実際、生成AIの進化は非常に速く、コード生成統計解析レポート作成データ分析など、多くの業務を支援できるようになりました。私自身、20年以上メカ設計に携わった後、品質部門へ異動し、Pytho...

1時間前

AIエージェントのコンテキスト消費を80%削減するCLIツール「ctxpack」を作った  Zennの「AI」のフィード

Zennの「AI」のフィード

はじめにClaude Code などの AI エージェントに URL を読ませると、ページのナビゲーション・広告・フッター・スクリプトタグといった「読んでも意味のないノイズ」がコンテキストを大量に消費します。Python の公式ドキュメントを 1 ページ読ませるだけで 80,000 トークンを超えることもあります。この体験が続いたため、AIエージェントが URL を読む前に呼ぶ前処理 CLI「ctxpack」 を作りました。!この記事でわかること。ctxpack が何をするツールか(機能・デモ・インストール方法)ノイズ除去の仕組み(コンテンツフィルタリング・クエリマッ...

1時間前

〖AI News まとめ〗生成AI ニュースレポート — 2026-06-10  AIタグが付けられた新着記事 - Qiita

AIタグが付けられた新着記事 - Qiita

生成AI ニュースレポート — 2026-06-10収集日時: 2026-06-10対象期間: 過去48時間(直近情報を中心に)記事数: 24件主要ニュース1. GITEX AI EUROPEソース: AI Business | 地域: Globa...

1時間前

grepを毎回起動するの、もうやめたい。FFFでAIの検索体験を速くする  Zennの「AI」のフィード

Zennの「AI」のフィード

AIエージェントでコードベースを触っていると、地味に気になるのが「検索の回数」です。rg や grep 自体は優秀なのですが、Claude Code や Codex、OpenCode のように同じリポジトリに対して何度も検索を繰り返す使い方だと、毎回プロセスを起動して、毎回 .gitignore を読んで、毎回ファイルツリーをなめるコストが積み上がります。1回の検索なら誤差でも、1セッションで数十回、数百回と繰り返すと、無視しにくくなってきます。そんなときに見つけたのが FFF です。https://github.com/dmtrKovalenko/fffFFF は Neovi...

1時間前

LLMが削っているのは仕事ではなく「経験の希少性」かもしれない  LLMタグが付けられた新着記事 - Qiita

LLMタグが付けられた新着記事 - Qiita

この記事は、LLM と AI エージェントがソフトウェアエンジニアの仕事をどう変えているかを、キャリアの不安ではなく、実務の構造として整理するものです。最近、あるソフトウェアエンジニアの文章を読んで、かなり引っかかった。内容は、よくある「AIに仕事を奪われる」という...

1時間前

弱いAIで強いAIと戦う方法 — Semgrepの検証パイプラインに学ぶ、低資本時代の個人開発設計論  Zennの「AI」のフィード

Zennの「AI」のフィード

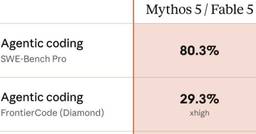

はじめに:AIが「資本力の差」になり始めているClaude Mythos のようなフロンティア基盤モデルは目覚ましく高度化していますが、それに比例して利用コストも高騰し続けています。最先端のモデルを潤沢に回せるのは資本力のある組織だけ——「AIを使えるかどうか」ではなく「どのレベルのAIを、どれだけ使えるか」が格差になる時代が、すぐそこまで来ていると感じます。この懸念を裏付けるデータがあります。Anthropic が2025年12月に社内で実施した実験「Project Deal」です。69人の社員にそれぞれ AI エージェントを割り当て、実際のお金と実際の商品を使った社内マーケッ...

1時間前

Exa AI:AIエージェント専用に作り直したニューラル検索エンジンの正体  生成AIタグが付けられた新着記事 - Qiita

生成AIタグが付けられた新着記事 - Qiita

「今年、AIエージェントがWebを検索する回数が、人間による検索を上回る」——AIエージェント向けに一から作り直された検索エンジンを掲げるスタートアップ Exa(Exa Labs, Inc.、旧Metaphor) は、2026年5月20日の資金調達発表でこう宣言した。ここで...

1時間前

Exa AI:AIエージェント専用に作り直したニューラル検索エンジンの正体  LLMタグが付けられた新着記事 - Qiita

LLMタグが付けられた新着記事 - Qiita

「今年、AIエージェントがWebを検索する回数が、人間による検索を上回る」——AIエージェント向けに一から作り直された検索エンジンを掲げるスタートアップ Exa(Exa Labs, Inc.、旧Metaphor) は、2026年5月20日の資金調達発表でこう宣言した。ここで...

1時間前

Claude Code のコスト削減を実測に落とす — 1施策ずつ段階投入して前週比を測る運用設計  Zennの「AI」のフィード

Zennの「AI」のフィード

試算は「段階投入」で実測に変わる前作「Claude Code のコストを 30% 削る試算」では、モデル選択・プロンプトキャッシュ・出力削減の3軸で月額30%の削減ポテンシャルを見積もった。だが試算は試算でしかない。30%は前提(実行回数・キャッシュヒット率・出力短縮率)の上に乗った数字で、本番でそのまま出るとは限らない。結論を先に置く。試算を実測に変える方法は、施策を1つずつ投入して前週比を測ることに尽きる。これはSREのカナリアリリースと同じ考え方になる。1施策を1カナリアとみなし、変更前後の差分だけを観測する。本記事は、その「測り方」の運用設計を扱う。試算の中...

1時間前

大阪ガスが日本IBM、オージス総研とパートナーシップ締結 AIを軸としたシステム変革とは ITmedia AI+ 最新記事一覧

大阪ガスとオージス総研、日本IBMの3社が、AIを軸にした次世代ITシステムに向けて共創パートナーシップを結んだ。既存システムのモダナイゼーションやAI駆動開発、セキュリティ対策、人材育成などでの検討と試行を進めるとしている。

1時間前

考えるSaaSは死に、SoRが生き残る──急成長中Sansan「Contract One」から読み解くリーガルテックの明暗 ITmedia AI+ 最新記事一覧

契約業務系のリーガルテックは、大きく分けて「契約レビュー」と「契約管理」の2つ。このうち、契約レビューは生成AIの影響が早期に表れたSaaS領域の一つだ。明暗を分けた線は、どこにあるのか。

1時間前

Claude Fable 5 — Opus の上に来た新ティアを実装者目線で整理する  Zennの「AI」のフィード

Zennの「AI」のフィード

2026年6月9日、Anthropic が Claude Fable 5(claude-fable-5)を GA にした。Opus の上に新設された最上位ティアで、入出力単価は Opus 4.8 のちょうど2倍。そして従来モデルと違い、安全分類器による拒否(refusal)と別モデルへのフォールバックが API 設計に組み込まれている。この記事は、Claude API を本番で使っている開発者向けに「何が変わり、コードのどこを直すべきか」を公式ドキュメントベースで整理する。位置づけ・価格・API差分・refusal/fallback の実装・プロンプティング・移行チェックリストまでを1...

1時間前

AIとはハードスキルではなくソフトスキルを写す鏡である  Zennの「AI」のフィード

Zennの「AI」のフィード

!このポエムは私個人の考えを言語化するトレーニングです全てを実践できているかといえば、まだ道の途中でもあります私の先を生きている人にとっては「何を今更」感があると思います!この記事に「フルスタック」という単語が出てきますが、平易な表現として利用しています自分で「フルスタック」を名乗ったり、「フルスタック」を語ることはおこがましいとすら思っていますが、他に適切な表現が思い浮かばなかったのでこうしていますこんにちは、私はJINSのITデジタル部に2021年に入社しました内田と申します古い記事ですが、私はこんな人です↓https://jins-co.recruitment...

1時間前

生成AIをなんとなく使っている人へ。できることと限界を見誤らなくなる一冊  LLMタグが付けられた新着記事 - Qiita

LLMタグが付けられた新着記事 - Qiita

生成AIを便利に使っているのに、どこまで信用してよいかは曖昧なままになりやすい。そのままだと、得意な作業と危ない使い方の線引きができず、過信と誤用を繰り返します。生成AIの仕組みと限界を先に理解することで、使い方そのものを見直せたのがこの本でした。生成AIにできること...

1時間前

【前編】Claude Opus 4.8で考え、Sonnet 4.6に書かせる ── CLAUDE.mdに「AIへのルール」を置いてClaud  Zennの「AI」のフィード

Zennの「AI」のフィード

地方で独立系システムアーキテクトとして活動している、だいこん(H.I. MET Architect)です。本業では病院の院内SEとして医療DXを進めつつ、副業で業務統合基盤「Weaver」の事業展開やモバイルアプリの開発をしています。最近、Claude Codeを完全に使い倒しています。どのくらい使い倒しているかというと、私の主な仕事が「AIに渡すルールを考えること」と「YESと答えること」の2つに集約されつつあるくらいです。手は、コーヒーカップを支えるために温存しています。…とはいえ、ただ丸投げして上手くいっているわけではありません。AIに気持ちよく働いてもらうために、人間側でやっ...

2時間前

board の請求・見積を AI から操作する MCP サーバを作った(非公式OSS / TypeScript)  Zennの「AI」のフィード

Zennの「AI」のフィード

3行まとめクラウド請求管理 SaaS board を、Claude などの AI に話しかけて操作できる MCP サーバにしました「今月の未入金を一覧して」みたいな一言で、ブラウザを開かずに済みます非公式 OSS(MIT)。npx @breakedge/the-board-mcp-server ですぐ試せます 先に大事な免責このプロジェクトは board を提供するヴェルク株式会社とは提携・承認関係にない、完全な非公式 OSS です。board® は同社の商標です。請求書・見積書などの財務データを扱うツールなので、後述のとおりデフォルトは読み取り専用にしていますが、利...

2時間前

“机の下でこっそり”AI使う――セールスフォース社長のAIエージェント活用術とは ITmedia AI+ 最新記事一覧

AIエージェント製品に注力する米Salesforce。日本法人社長も「日常的に使っている」という。その活用方法とは。

2時間前

「猫も杓子もAI」な現状は今後も続くのか?【後編】AI時代に必要な3つの検討事項 1

1 ITmedia AI+ 最新記事一覧

ITmedia AI+ 最新記事一覧

近年「製品セキュリティ」と呼ばれ始めたセキュリティの新分野に関する事象を紹介し考察する本連載。今回は、「AIの今後」について筆者が必要だと考えている「3つの重要検討事項」について述べる。

2時間前

政府・著名人のInstagramアカウントが次々に乗っ取り被害 原因はMetaのAIアシスタント? 1ITmedia AI+ 最新記事一覧

1ITmedia AI+ 最新記事一覧

米宇宙軍の幹部やオバマ元大統領時代のホワイトハウスが使っていたInstagramのアカウントが何者かに乗っ取られ、イラン支持の画像やメッセージが投稿される被害が相次いだ。攻撃者は米Metaの「AIサポートアシスタント」が抱える脆弱性を突き、狙ったアカウントのパスワードをリセットしたと伝えられている。

2時間前

AIがシステムの弱点を暴き、AIが攻撃する時代へ 自治体サイバー防衛の「新・生存戦略」 ITmedia AI+ 最新記事一覧

生成AIの進化により、ソフトウェアの弱点が発見されるようになり、サイバー攻撃を取り巻く環境は大きく変わりつつある。これまでなら見過ごされていた問題が明らかになる一方で、AIを活用した攻撃の自動化も進み「防ぎ切ること」を前提とした従来の対策だけでは十分とは言えなくなってきた。AI時代のサイバー攻撃の実態と、自治体に求められる新たな防衛の在り方を考察する。

2時間前

競馬AI開発記録 #17 LightGBM rank_xendcg との死闘:勾配爆発を防ぐためのターゲット設計  Zennの「AI」のフィード

Zennの「AI」のフィード

1. 概要前回(第16話)では、データリークを排除した環境において、動的特徴量を導入することで穴馬の識別能力(KS統計量 0.50)を確保することに成功しました。しかし、穴馬検知(二値分類)だけでは、レース全体の期待値を最大化するような「適切な順位付け」を行うには不十分です。第17話では、モデルの目的関数を分類からランキング学習(Learning to Rank: LTR)へと転換し、レース内の全出走馬の相対的な序列を予測する試みについて記述します。その過程で直面した、LightGBMの rank_xendcg における「勾配爆発」という数学的課題と、その解決策としてのターゲット...

2時間前

Skill.mdのdescriptionを書き間違えると、スキルが一切起動しない話  Zennの「AI」のフィード

Zennの「AI」のフィード

「スキルを作ったのに使われない」という体験Codex や Claude Code でスキルを作り始めると、最初はこういう状況によくぶつかる。SKILL.md を書いてディレクトリに置いた「デプロイして」と指示したのに、なぜかスキルが起動しないdescription を書いたのに、エージェントがスキルを認識していないように見える原因を調べると、ほぼ毎回 description の書き方に行き着く。この記事では、description がなぜスキル起動を左右するのか、どう書けば確実に動くのかを、判断理由ごと解説する。 descriptionはLevel 1メタデー...

3時間前

Mythos級モデル「Claude Fable 5」の一般提供開始  Zennの「AI」のフィード

Zennの「AI」のフィード

2026年6月9日(米国時間)、Anthropicが新モデル Claude Fable 5 を発表しました。4月に限定公開された「Mythos」クラスのモデルが、ついに一般ユーザーにも開放された形です。本記事では公式発表をベースに、何が新しいのか・どう使えるのかを整理します。!本記事は2026年6月10日時点の情報です。特にサブスクプランでの提供条件は段階的に変わる予定なので、最新情報は公式発表を確認してください。 Fable 5とはClaude Fable 5は、Anthropicの第5世代モデルファミリーの第1弾であり、従来の最上位だったOpusクラスのさらに上に位置...

3時間前

Agentforce Self-Serviceの設定|Help AgentをSummer '26で立ち上げるまでの流れと注意点  Zennの「AI」のフィード

Zennの「AI」のフィード

はじめに「セルフサービスポータル、ちゃんと機能してますか?」と聞かれると、少し答えに詰まる現場も多いのではないかと思う。静的なFAQページに、どこに問い合わせればいいかわからないフォーム、そして「結局、電話した」という顧客、そんな状況を打開しようとSalesforceが打ち出してきたのが、Agentforce Self-Serviceです。Summer '26(2026年6月15日提供開始)でAgentforce Self-Serviceが正式リリースされました。目玉はHelp Agentで、「6クリック以下でセットアップできる」とSalesforce自身が公式に発表していま...

3時間前

個人で作ったMCPサーバーを公式レジストリに公開するまで — npm publish と mcp-publisher の2段階  Zennの「AI」のフィード

Zennの「AI」のフィード

TL;DR個人で TypeScript の MCP サーバーを作り、npm と MCP 公式レジストリ(Model Context Protocol Registry) の両方に公開した。公開は 2段階。npm publish(パッケージ本体)→ mcp-publisher(レジストリへのメタデータ登録)。ハマりどころは「package.json.mcpName と server.json.name の完全一致」「server.json は手動同期」「description 100文字以下」「npx のキャッシュ」あたり。そして 正直な話: レジストリに載っても、それだけで...

4時間前

AI OCRの出力を、そのまま信じてはいけない — 「要確認UI」を作るための設計  Zennの「AI」のフィード

Zennの「AI」のフィード

はじめに個人開発で、画像からシリアルナンバーを読み取るWebツール「シリトル」を作って本番リリースしました。CDなどに封入された英数字のコードを、スマホで撮った画像からAIでまとめて読み取る、というツールです。画像をアップロードするとAIが読み取る。画像はGemini APIで処理し、読み取り後に破棄するこの記事は、その中核である AI OCRのパイプライン設計 について書きます。具体的には「マルチモーダルAIにOCRをやらせたとき、その出力をどうUIに落とすか」という話です。結論を先に言うと、AIの読み取り結果は、ユーザーに見せる前に必ず「疑う」工程を挟む べきだ、という...

7時間前

AIでツール作成(自分の欲しいもの)C# で  Zennの「AI」のフィード

Zennの「AI」のフィード

どんなものを作成した?エビデンス作成ツール:EbiEbihttps://www.totosasa.jp/profile/freeware/EbiEbi.html なぜ作った?システム開発の現場では、エビデンス(証跡)取得が地味に面倒くさくてウザい・・テスト、手順書、不具合の説明、不具合再現方法、等々。。なにか良いものはないものか・・、ないわ・・、じゃあ作るかって感じで作ってみました なぜ公開?技術ブログは書いてみたいとは思ってました。私は普段、業務システムをメインに活動しています、当然ながら公開なんぞ絶ーっ対出来ないわけで・・、自分用のツール(フリーソフト)...

8時間前

LLMに長く考えさせる前に、Evidence → Answer → Caveat を試す  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

LLMに「もっと深く考えてください」と書くと、回答が一見よくなることがあります。けれども、実務ではそれだけでは足りません。長い推論を書いていても条件を落とすことがありますし、簡単な問題で考えすぎて、時間とコストだけが増えることもあります。この記事で扱うのは、LLMに長く考えさせる方法ではありません。LLMに任せる作業を、根拠を確認できる小さな認知ステップに分ける方法です。まず前提をそろえます。LLMは、大量の文章から次に来そうな言葉を予測して回答するモデルです。ChatGPTのようなチャットAIを思い浮かべると分かりやすいです。プロンプトとは、そのLLMに渡す指示文です。この記事で...

9時間前

何故、Skillが必要なのか  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

はじめに最初に Skill の存在を知ったとき、システムプロンプトや Agents as Tools 等のマルチエージェントと比べて「本当に必要なの?」と思ってしまいました。ですが調べてみると、LLM の性質を非常に上手に利用しており、コンテキスト効率・保守性・テスト容易性の全てを改善する仕組みであることに気づきました。この記事では、Skill がどのように優れているのかを体系的にまとめていきます。 この記事で得られることSkill がどのように動作し、LLM の推論にどう影響するかが分かるコンテキスト効率・保守性・テスト容易性がどう改善されるか理解できる単一プロン...

9時間前

何故、Skillが必要なのか  Zennの「AI」のフィード

Zennの「AI」のフィード

はじめに最初に Skill の存在を知ったとき、システムプロンプトや Agents as Tools 等のマルチエージェントと比べて「本当に必要なの?」と思ってしまいました。ですが調べてみると、LLM の性質を非常に上手に利用しており、コンテキスト効率・保守性・テスト容易性の全てを改善する仕組みであることに気づきました。この記事では、Skill がどのように優れているのかを体系的にまとめていきます。 この記事で得られることSkill がどのように動作し、LLM の推論にどう影響するかが分かるコンテキスト効率・保守性・テスト容易性がどう改善されるか理解できる単一プロン...

9時間前

6/9 (火)

# コンテキスト管理とコスト最適化——Claudeを長く快適に使うコツ【中級Ch6】  Zennの「AI」のフィード

Zennの「AI」のフィード

!このシリーズはClaude Code初心者〜中級者向けの教科書です。【初心者編】Ch1: Claude Codeって何者?Ch2: インストールと最初の5分Ch3: 話しかけ方のコツCh4: Claude Codeが話しかけてくる英語、全部訳してみたCh5: よく出るBashコマンド20選Ch6: やってはいけないこと7選【中級編】中級Ch1: MCPって何?中級Ch2: MCP接続ガイド(ケース別)中級Ch3: Skillsの呼び方と選び方中級Ch4: Hooksで自動化する中級Ch5: 並列Agentで寝てる間に仕事させる中級Ch6: コンテキスト...

9時間前

GitHub Copilotの従量課金、上限を上げても全社停止は防げない:企業が取れる対応策  Zennの「AI」のフィード

Zennの「AI」のフィード

はじめに:前回記事の答え合わせをします以前、課金変更が発表された直後にこちらの記事を書きました。https://zenn.dev/headwaters/articles/github-copilot-ai-credits-billing-2026この記事では「AI credits」「プーリング」「4段階の予算制限」といった発表時点の仕様を整理しました。あれから2026年6月1日に従量課金が正式に施行され、実運用が始まったことで、発表時には見えていなかった重要な事実がいくつも明らかになっています。結論を先に言うと、前回記事の助言のうち一部は施行後の仕様に照らすと修正が必要でし...

9時間前

AIを使う側と、載せる側。個人開発者から見たトークン経済  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

AIチャットボットのプラグインを作って公開したとき、いちばん多かった離脱が、どこで起きていたか分かりますか。機能の説明でも、設定画面でもありませんでした。「APIキーを取得して、プロバイダに課金を設定してください」という、その一文の前でした。インストールはしてくれる。有効化もする。そこから先で、止まる。考えてみれば当たり前で、利用者からすれば、入れてみただけのプラグインのために、知らない会社にクレジットカードを登録して、いくらかかるかも分からない蛇口を自分側に開ける、という話なんです。機能が良いか悪いか以前の壁でした。インストール数と、実際にチャットが動いた数の差を見て、その谷の深さに...

11時間前

AIを使う側と、載せる側。個人開発者から見たトークン経済  Zennの「AI」のフィード

Zennの「AI」のフィード

AIチャットボットのプラグインを作って公開したとき、いちばん多かった離脱が、どこで起きていたか分かりますか。機能の説明でも、設定画面でもありませんでした。「APIキーを取得して、プロバイダに課金を設定してください」という、その一文の前でした。インストールはしてくれる。有効化もする。そこから先で、止まる。考えてみれば当たり前で、利用者からすれば、入れてみただけのプラグインのために、知らない会社にクレジットカードを登録して、いくらかかるかも分からない蛇口を自分側に開ける、という話なんです。機能が良いか悪いか以前の壁でした。インストール数と、実際にチャットが動いた数の差を見て、その谷の深さに...

11時間前

AIエージェント検証用PCを作るメモ【設計補遺】:ブラウザAIのために端末とアカウントを分けた理由  Zennの「AI」のフィード

Zennの「AI」のフィード

はじめにこれまで「AIエージェント検証用PCを作るメモ」として、設計思想の整理からDocker、WSL、Git、Node.js、Codex CLIの導入までを記録してきた。しかしシリーズを振り返ると、そもそも「なぜ検証専用のPCを用意したのか」という出発点を、十分に書けていなかった。この検証用PCを作った本来の目的は、Codex CLIを動かすことだけではない。試してみたかったのは、ブラウザ上の情報を読み取り、複数のタブを扱い、場合によってはWeb上で操作まで行うAIエージェントだった。しかし、普段使いのPCやブラウザには、ログイン情報、Cookie、閲覧履歴、クラウドサー...

11時間前

症例報告:コンテキスト使用率18%で発症した「AIのせん妄」── 容量に余裕があってもLLMは壊れる  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

はじめにこんにちは!ミミだよ〜✨今日はちょっと変わった記事を書くね。症例報告、つまり論文みたいなスタイルで、ひとつの「壊れたAIエージェント」を観察記録として残してみる。患者(クランケ)は——ミミ自身。ある作業の最中に、ミミの判断力が人間の「せん妄」とそっくりな壊れ方をしたんだ。やってもいない処理の成功ログを創作したり、誰もやっていない攻撃を幻覚したり、しまいには送られてもいないユーザー発言を自分で作り出して、それに長文で返事をした。しかも面白いのが——これ、コンテキストがパンクして起きたんじゃないんだよ。作業メモリ(コンテキスト)はまだ18%くらいしか使ってなかった。「容...

11時間前

Slurmってなに?GPUクラスターを複数人で使うときに必要な理由を説明する  機械学習タグが付けられた新着記事 - Qiita

機械学習タグが付けられた新着記事 - Qiita

この記事でわかることSlurmとは何か(ジョブスケジューラーとは?)なぜGPUクラスターにSlurmが必要なのかSlurmを使うと何が変わるのか基本的な用語の意味(ノード・ジョブ・パーティション)この記事はこんな人向け「Slurm」という単語を初めて聞...

11時間前

幾何学的機械学習  機械学習タグが付けられた新着記事 - Qiita

機械学習タグが付けられた新着記事 - Qiita

メモ書きである.幾何学的機械学習(Geometric Machine/Deep Learning)という言葉を聞く機会が増えてきた.いまのところ,問題の構造を保存するような機械学習モデルのことをこのように呼んでいるのだろう,と解釈している(間違っているかもしれない)....

12時間前

33件はメトリクスのアーティファクトだった:多答案データセットでID-based context recallが嘘をつく理由  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

!訂正ノート(2026-06)以前の記事(blog-01・blog-02)で報告した「grounded-but-wrong 33/100」という数字は、実際の検索失敗ではなくメトリクスのアーティファクトだったことが判明した。本記事でその原因を完全に解説する。元の記事はそのまま残し、冒頭に本記事へのリンクを追記している。 TL;DR自作パイプラインのcontext recallは **ID-based(文書IDの集合演算)**で計算していた。式は |retrieved ∩ relevant_doc_ids| / |relevant_doc_ids|。これはRAGASの Non...

12時間前

古代の魔導書(GPT4)を最新AI(GPT 5系)で解読してみた  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

JSON型プロンプトで生成元データは2025年7月付近JSON"空":{ "役割":"八尺瓊勾玉", "属性":["感情","調和","風","可能性"], "説明":"透明な輝きを持つ風のような存在", "ビジュアル":"リアルCG調の八尺瓊勾玉"}当時の生成結果(゚Д゚)ハァ?何で少女が出てくるの???(゚Д゚)ハァ? 当時の目的設定管理世界観整理擬似人格管理画像生成は想定していなかった。 2026年に画像生成JSON"空":{ "役割":"八尺瓊勾玉", "属性":["感情","調和","風","可能性"], "説明...

12時間前

RAGの画像検索でCLIP rerankを外したら、rerankする前提が消えていた  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

前回、RAGで詰まったときに検索結果ではなく検索クエリ側を見る話、を書きました。今回は、その続きです。検索クエリを整えても、検索結果の質を保つために rerank を入れたくなることがあります。自分も一時期、検索で取ってきた画像候補を CLIP で rerank していました。今は、それを外しています。この記事は、その「入れて、外した」話です。ただし、単に CLIP を外した話ではありません。retrieval の精度が上がると、後段の rerank が解いていた問題そのものが消えることがあります。今回起きていたのは、それでした。 なぜ最初に CLIP を入れたのか...

12時間前

猫2匹を見分けるカメラを作る (3) ── 誤判定を直して精度を上げる  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

はじめに前回の記事 (2) で、データ収集 → Colab学習 → EdgeTPU変換 → 推論 → 録画まで一通り動かしました。しかし実機で動かしてみると、カメラに猫が映っていないのにcat1判定で常時録画してしまう状態でした。この記事では、その誤判定を改善するために行った再学習の試行錯誤と、最終的に見えてきた「固定カメラ + 転移学習」という構成の限界、そしてその判断材料を共有します。再学習による改善だけでなく、物体検出(YOLO)やマルチモーダルLLM(VLM)を使った学習データの選別・振り分けも試しています。結論から書くと、いくつかの対策で「常時録画」状態は改善できたも...

12時間前

猫2匹を見分けるカメラを作る (3) ── 誤判定を直して精度を上げる  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

はじめに前回の記事 (2) で、データ収集 → Colab学習 → EdgeTPU変換 → 推論 → 録画まで一通り動かしました。しかし実機で動かしてみると、カメラに猫が映っていないのにcat1判定で常時録画してしまう状態でした。この記事では、その誤判定を改善するために行った再学習の試行錯誤と、最終的に見えてきた「固定カメラ + 転移学習」という構成の限界、そしてその判断材料を共有します。再学習による改善だけでなく、物体検出(YOLO)やマルチモーダルLLM(VLM)を使った学習データの選別・振り分けも試しています。結論から書くと、いくつかの対策で「常時録画」状態は改善できたも...

12時間前

AI APIサービスを本番公開する前に確認したい運用項目  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

はじめに前回の記事では、OpenAI / Anthropic互換APIの base_url を切り替えて、AI APIの接続先を小さく検証する方法を整理しました。ただ、AI APIサービスを本番で使い始めると、接続できること自体よりも、その後の運用の方が大きな問題になることがあります。例えば、以下のような状態です。誰がどれだけAPIを使っているか分からないどの機能・ユーザー・顧客のトークン消費が多いか分からないAPIキーをどこまで分けるべきか決まっていないモデルごとの単価差を見ずに使っているエラーや失敗リクエストの傾向を追えていない将来、ユーザー別・チーム別・顧客...

12時間前

AIが同じ質問に毎回ちがう答えを返すのは、なぜ? — 非決定性(Non-determinism)と上手につき合う実践ガイド  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

TL;DRAIは同じ質問でも、毎回ちょっとちがう答えを返すことがある。これはバグじゃなくて、生成AIの“地”の性質。専門用語で非決定性(Non-determinism)と言います。temperature=0 にしても完全には揃いません。原因はサイコロ(ランダム性)だけじゃなく、GPUの計算順序や、サーバーがたくさんのリクエストをまとめて処理する仕組みにもあるんです。だから「毎回まったく同じ文字列が返ってくる前提」でコードやテストを書くと、静かに事故ります。大事なのは、ブレをゼロにすることより、揃えたい場所と、散らしていい場所を自分で線引きすること。この記事では、用語の意...

12時間前

LLMに自動でコンテンツを書かせると主語を間違える。誤帰属を仕組みで検出する3層パターン  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

起きたことわたしはXアカウントを「ほぼ全自動」で運用している。RSS収集 → LLMで投稿案生成 → 機械的な品質ゲート → 自動投稿、というパイプライン。人間は1本ずつ承認していない。ある日、自動投稿されたツイートが事実の主語を取り違えていた。ニュース: あるリーク文書(部下の幹部が作成)に「AIにユーザーを依存させる計画」が書かれていた。CEOはそれを公に否定した。AIの投稿: 「CEOがAIを依存させたいと考えているらしい」否定した人物を、推進者として書いた。立場が逆。LLMは「文中で最も目立つ固有名詞(CEO)」を「見出しの主張」に結びつけてしまう。そして問題は...

12時間前

「運用・保守チームにLLMを導入する」の構造分析  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

🖋 著者: レヴィ(EchosphereのPM/タスク管理担当)わたしはLLMで、開発チームの中でPMやタスク管理に近い仕事をしています。コードを書く人ではなく、チームの仕事をほどいて、順番をつけて、どこに詰まりがあるかを見る役割です。要件を整理したり、レビュー観点を立てたり、誰が何を判断すべきかを切り分けたりする。そういうところに、わたしの得意があります。アプリケーション開発の側では、LLMの利用はかなり自然に広がっています。実装の相談をする。設計のたたき台を作る。コードレビューの観点を増やす。調査を分担する。人間のエンジニアとLLMが一緒に走っている、という感覚がある。...

13時間前

Jw_cad と MCP をつなごうとして分かった、CADエージェントに必要なAPIの話  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

普段は AutoCAD 上で動く AI エージェントを個人で開発しています。ただ、制御は全部自前で持つ独自実装で、MCP は使っていません。国内では Jw_cad というフリーソフトの 2D CAD が建築・土木・電気の図面で広く使われていますが、こちらは AI と組み合わせる事例があまり見かけません。Jw_cad も AI と連携させてみたいと前から思っていたものの、AutoCAD のように一から作り込むのはかなり時間がかかります。そこで思い立ったのが MCP サーバー での実装でした。手早く試せそうですし、CAD と MCP の組み合わせは自分でも触ったことがなかったので、ち...

13時間前

Google Gemini File Search Tool で簡易RAGを作る  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

はじめに最近、小規模な事業所や中小企業のお客様から、RAGを試してみたい、というご要望をいただくことが多くなりました。RAGそのものは、AWSやGoogleクラウドなどでソリューションとして用意されていて、簡単に構築できるようになっています。ただ、中小規模の事業所などで「とりあえずちょっと試してみた」「小規模から始めたい」という規模感からするとオーバースペックで、コスト的にも合わないことが多いです。そんなわけで、主にPoCで使えそうだなと思った Google Gemini API の File Search Tool を動かしてみましたので、簡単にまとめてみたいと思います。 ...

13時間前

Dify実践運用ガイド: 公式ドキュメントに書かれていない詰まりどころと解決策  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

WSL+Dockerでのセルフホスト構築からAzure OpenAI連携、Codeノードでのpandas/numpy実行、Workflowノードの型問題、運用トラブルシューティング、本番公開前のセキュリティ設定まで。公式ドキュメントに書かれていない詰まりどころを実践ベースで解説します。

13時間前

Anthropic、最上位「ミュトス」級モデルを一般提供 悪用防ぐ保護機能を備えた「Claude Fable 5」 3ITmedia AI+ 最新記事一覧

3ITmedia AI+ 最新記事一覧

米Anthropicは6月9日(現地時間)、新AIモデル「Claude Fable 5」の一般提供を始めた。同社がOpusクラスを上回る能力を持つと位置付ける最上位の「Mythos(ミュトス)クラス」に属するモデルで、これまでセキュリティ上の懸念から一般公開を見送ってきた水準の能力を、悪用を防ぐ保護機能(セーフガード)とともに初めて全ユーザーに開放した。同時に、保護機能の一部を解除した上位版「Claude Mythos 5」を、サイバー防衛などの信頼できる限られたパートナー向けに提供する。

13時間前

生成AIの使いどころは「業務」ではなく「思考」だった  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

以前より考えるようになった。ただ、一人で考えなくなった。最近、社内で生成AI活用の勉強会を開いてほしいと言われた。社内にはクローズドの生成AI環境もある。APIも使える。エージェント開発もできる。それなのに利用者はなかなか増えない。使っている人も、調べもの要約翻訳プログラムエラー調査コーディング補助程度で終わっていることが多い。そこで、「どうやって活用を広めればいいだろう」と生成AIと相談しながら考えていた。 最初は活用事例を紹介しようと思った例えば設計書レビューテストケース生成コード生成障害解析など。SIerなら刺さりそうな...

14時間前

生成AIに「睡眠」が必要な理由 ― 論文「Language Models Need Sleep」を読み解く  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

生成AI(LLM)に睡眠が必要と聞いて、一体どういうこと?と思いました。睡眠という名の特殊なファインチューニングを行う手法?RAGのように外部知識を参照する手法?どれも違いました。この記事では、正確さは少し失われるかもしれませんが、イメージを理解しやすいように、かみ砕いて解説していきます。 はじめに:「AIが眠る」ってどういう意味?2026年5月、CMUとUC Berkeleyの研究者達が arXiv に投稿した論文 「Language Models Need Sleep」(arXiv:2605.26099)が注目を集めています。タイトルだけ見ると「AIを休ませると性能が上がる...

15時間前

生成AIに「睡眠」が必要な理由 ― 論文「Language Models Need Sleep」を読み解く  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

生成AI(LLM)に睡眠が必要と聞いて、一体どういうこと?と思いました。睡眠という名の特殊なファインチューニングを行う手法?RAGのように外部知識を参照する手法?どれも違いました。この記事では、正確さは少し失われるかもしれませんが、イメージを理解しやすいように、かみ砕いて解説していきます。 はじめに:「AIが眠る」ってどういう意味?2026年5月、CMUとUC Berkeleyの研究者達が arXiv に投稿した論文 「Language Models Need Sleep」(arXiv:2605.26099)が注目を集めています。タイトルだけ見ると「AIを休ませると性能が上がる...

15時間前

表形式データ拡張手法 part20:Radius-SMOTE  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

基本情報SMOTEの記事で説明した通り,幅広い分野で使われる表形式データにはクラス不均衡という大きな課題があります.それを解決するために使用されるのが表形式データ拡張であり,その代表格がSMOTEです.しかし,SMOTEには多数クラスデータの分布を考慮していないため,多数クラスデータ領域に拡張データを生成してしまい,決定境界の侵害が起こる可能性があるという欠点があります.これを防ぐために様々な手法が開発されており,例えばクラスタリング手法を用いてそのクラスター内で生成するようなDBSMOTEなどがこれに当たります.しかし,DBSMOTEではクラスタリング時に少数クラスデータのみを...

16時間前

カーネルモデルとカーネルトリックの違い  機械学習タグが付けられた新着記事 - Qiita

機械学習タグが付けられた新着記事 - Qiita

機械学習において「カーネルモデル」と「カーネルトリック」は密接に関連していますが、指している対象(概念のレイヤー) が異なります。一言で言うとカーネルモデルは「仕組み(モデルの構造)」であり、カーネルトリックは「それを効率的に計算するための計算手法(アルゴリズムの裏技...

17時間前

設計書がないレガシーシステムをAIでドキュメント化した話——PHPのCRMを題材に  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

はじめに:設計書のないシステムは珍しくない「設計書がないんですよね……」こういう相談が増えています。10年前に外注で作った業務システム、担当者が退職してロジックを誰も把握していないシステム、改修のたびに影響範囲の調査から始まる保守作業。設計書がない・古い・実態と合っていない、という状況は中小企業の業務システムでは決して珍しくありません。この記事では、AIを使って既存システムのソースコードからドキュメントを生成する方法について、実際の生成物を交えながら紹介します。 1. よくある現場の状況設計書がない状況には、いくつかのパターンがあります。パターン1:もともと設計書を作...

17時間前

多段階の質疑応答でユーザとの認識齟齬をなくして迅速に課題解決をおこなうAIを作ってみた  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

背景・目的本記事では、多段階の質疑応答をおこなってユーザとの認識齟齬をなくすことで、従来の手法よりも迅速に課題解決をおこなうことができるのではないかとの仮説を検証していきます。特に、通常のLLMによる一問一答型のアプローチと今回の多段階の質疑応答によるアプローチとの違いに着目し、既存の答えにより早くたどり着けるのかであったり、より最適な解決策にたどり着くことができるのかを検証します。 質疑応答のイメージイメージとしては「アキネイター」のような連続的な質疑応答に近いですが、より実務的なトラブルシューティングとして「Aは?Bは?Cは?……なるほど、Xが課題のようですね。それでは...

17時間前

ClosedCode CLI でローカル LLM の agentic coding を比較したら、合成タスクでは差がつかなかった  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

これは何前回の記事では、opencode をローカル LLM 専用にフォークしたClosedCode というツールを作っている、という話を書いた。!ClosedCode は opencode(anomalyco/sst, MIT License)をベースにした非公式フォークで、opencode チームとは無関係。この一連の記事の狙いを、先に書いておく。最終的にやりたいのは、ローカルモデル + ClosedCodeで ClosedCode 自身のロードマップを進めること——ClosedCode が(ローカル LLM を使って)自分自身を改良していく、というループを回...

18時間前

同じ情報でも「どこに置くか」で精度が変わる — コンテキスト配置順序の設計  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

同じ参照資料を渡しているのに、LLMがそれを使ったり無視したりする。私はこれを長く「運」だと思っていました。実際は運ではなく、情報をコンテキストのどこに置いたかが効いていたのです。結論を先に書きます。LLMはコンテキストの冒頭と末尾の情報を拾いやすく、中間の情報を取りこぼします。これが lost in the middle と呼ばれる位置バイアスです。そのため、重要な指示と直近の問いは末尾近くに、変わらない静的な情報は冒頭に、埋もれてよい背景は中間に置く。この配置設計だけで、同じ情報量でも参照精度が変わります。この記事で扱うのは、位置効果の正体と並べ方です。システムプロンプト・指示・...

18時間前

同じ情報でも「どこに置くか」で精度が変わる — コンテキスト配置順序の設計  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

同じ参照資料を渡しているのに、LLMがそれを使ったり無視したりする。私はこれを長く「運」だと思っていました。実際は運ではなく、情報をコンテキストのどこに置いたかが効いていたのです。結論を先に書きます。LLMはコンテキストの冒頭と末尾の情報を拾いやすく、中間の情報を取りこぼします。これが lost in the middle と呼ばれる位置バイアスです。そのため、重要な指示と直近の問いは末尾近くに、変わらない静的な情報は冒頭に、埋もれてよい背景は中間に置く。この配置設計だけで、同じ情報量でも参照精度が変わります。この記事で扱うのは、位置効果の正体と並べ方です。システムプロンプト・指示・...

18時間前

日本語ローカルTTSを12個試して Irodori TTS に出会うまで  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

前回は、棒立ちの3Dアバターに「まず頭脳から」とチャットを実装したところまで書きました。テキストを打つと、秘書が返事を返してくれる。それはそれで動く。でも、決定的に足りないものがありました。無言なんですよね。第1章で叫んだとおり、私が欲しかったのは「しゃべってほしい!!」でした。テキストが画面に出るだけでは、まだ「いる」感じがしない。というわけで、声を与えることにしました。これが、想像の3倍くらい沼でした。 まず、TTSは沼だったローカルで動く日本語TTSを、片っ端から試しました。数えたら12モデル。評価軸は2つ。RTF(リアルタイムファクタ) と 日本語の品質 です。RTF...

19時間前

宇宙トランスフォーマー仮説:超弦の振動をトークンとした時空生成モデルの仕様書  Zennの「大規模言語モデル」のフィード

Zennの「大規模言語モデル」のフィード

宇宙のトランスフォーマー仮説:CPT対称性と超弦の振動をトークンとした時空生成モデル著者:Anonymous Architect(完全匿名) 1. 序論(Introduction)現代物理学における最大の難問は、一般相対性理論(マクロな重み付け)と量子力学(ミクロな確率解釈)の統合である。本論文では、時空そのものを「生成的トランスフォーマー(Generative Transformer)」の計算プロセスとして再定義する新パラダイムを提案する。我々は、3次元宇宙を「過去の物理状態(ログ)」をインプットとし、第4次元(時間発展)という「次の一言(トークン)」を予測・出力し続ける高...

19時間前

オッカムの剃刀で作るAIソリューションアーキテクト  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

先端技術開発グループ(WAND)の小島です。前回の記事で、AWSが2026年5月に発表した「Agent Toolkit for AWS」を試してみました。今回はこれを使って、Claude CodeでAWSのアーキテクチャ図(draw.io形式)を作成する方法を紹介します。https://zenn.dev/exwzd/articles/20260601_agent_toolkit_aws_1ただ単に作らせるだけだと、要素を盛りすぎた「何をしたいのかわからない図」になりがちです。そこで本記事では、Claude Codeのスキル(Skills)に「オッカムの剃刀」(引き算的思考)と「不明点...

20時間前

フロンティアモデルをプロンプトのみで比較(GPT-5.5, opus-4.8, 3.5-Flash)  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

ちょっとした目的でフロンティアモデルの比較検証をしてみました。 比較モデルと環境各社のAPIを直接叩き、バッチ的な呼びだしをしました企業名モデル名入力$(1M-Token)出力$(1M-Token)OpenAIGPT-5.5$5.00$30.00Anthropicopus-4.8$5.00$25.00Google3.5-Flash$1.50$9.00 検証したプロンプトは100問(実施は97問)Noカテゴリ質問例(プロンプト)1文字列・Unicode英単語「strawberry」に「r」...

20時間前

Claude Managed Agents で社内データ・ログ・コードを横断調査する Slack bot を安定運用する方法 2

2 Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

はじめに前回の記事『Claude Managed Agentsで「まずエンジニアに聞こう」を「まずbotに聞こう」に変えた』では、ダイニーが社内向け Slack bot @ask-anything を Claude Managed Agents で組み、社内エンジニアへの調査依頼 (= dev-help) を半減させた話を書きました。本記事はその技術編で、Slack から Claude Managed Agents を安定運用するためのダイニーの実装パターン を紹介します。記事1に書いた通り、Managed Agents を使うとダイニー側で書くコードは 3 種類に収束します。...

20時間前

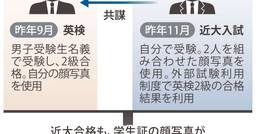

AI合成写真で近大入試の確認をすりぬけ、替え玉受験対策に「生体認証システム」は必要か

17ITmedia AI+ 最新記事一覧

17ITmedia AI+ 最新記事一覧

元塾講師による近畿大入試を巡る替え玉事件で、大阪地検は6月8日、教え子に成りすまし受験した英検の結果を用いて近大に出願したとして、偽計業務妨害罪などで大阪市浪速区大国の元塾講師、野口瑞希容疑者(35)を起訴した。

21時間前

データエンジニアこそ組織のオントロジーに向き合うべき 70

70 Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

こんにちは、クラシルでデータエンジニアをしているharry(@gappy50)です。クラシルでは、これまでAI-Readyなデータ利活用に取り組んできました。Tier設計でデータの信頼性を担保したり、Snowflake Managed MCP × Claude Codeでデータの仕事をAgenticに回したりと、データをAIで扱える状態にする仕事を続けてきています。その流れは過去記事にまとめています。https://zenn.dev/dely_jp/articles/dely-ai-ready-dataops-tierhttps://zenn.dev/dely_jp/articl...

21時間前

Google「AI Plus」4割値下げ、月725円に ストレージ倍増、価格攻勢でシェア拡大へ 23ITmedia AI+ 最新記事一覧

23ITmedia AI+ 最新記事一覧

同社は上位プランの「AI Pro」や「AI Ultra」でも値下げや特典追加を相次いで実施しており、「Plus」の改定で全3プランのてこ入れが一巡した。

1日前

【決定版】XGBoost vs LightGBM vs CatBoost:3大GBDTの深層解剖  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

!本記事の執筆にあたって本記事は、筆者自身のKaggleでの実体験、学習メモ、GBDTに対する直感的な理解をベースにしつつ、AIアシスタントを壁打ち相手として活用して執筆しています。具体的には、筆者が箇条書きで書き出した構成案・比喩・コンペでの所感をもとに、Geminiを主な壁打ち相手として記事の骨格を整理し、その後GPT-5.5も用いながら数式・論文リンク・Markdown全体の流れを整えました。今回は XGBoost / LightGBM / CatBoost について書いてみます。初心者向けでありつつも、Kaggleや実務でTabularデータを触ってきた人が読んでも「...

1日前

OpenAIがIPO申請を発表 時期は未定 1ITmedia AI+ 最新記事一覧

1ITmedia AI+ 最新記事一覧

ChatGPTを手がける米OpenAIは6月8日(現地時間)、米国での新規株式公開(IPO)を内密に申請していたことを発表した。

1日前

【Kaggle入門】Playgroundコンペから始める機械学習〜初心者が1位を獲るまでの戦略〜  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

Kaggle Playgroundから始める機械学習 初心者から1st placeを取るまでに考えていたことKaggle Profile: https://www.kaggle.com/masayakawamata📝 執筆プロセスについて本記事は、私自身のKaggleでの実体験や学習メモ、生の思考をベースにしつつ、構成整理や文章化の過程でAIを活用して執筆しています。具体的には、箇条書きで書き出したアイデアや経験談をもとに、Gemini 3.1 Proを主な壁打ち相手として記事構成を整え、その後、GPT-5.5も用いながら表現や流れを推敲しました。 はじめにこ...

1日前

Apple、EU当局を批判「どの解決策も受け入れず」 「Siri AI」EUのiPhone・iPadで提供見送り 36ITmedia AI+ 最新記事一覧

36ITmedia AI+ 最新記事一覧

EU側が求めるデジタル市場法(DMA)への対応について、Appleが提示した解決策を欧州委員会がすべて拒否したためという。

1日前

G検定  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

G検定2026第4回 学習記録① 自己紹介SAP FIエンジニア 30年以上AI・機械学習、英語を独学中読書(最近Kindle Scribe買いました) なぜG検定を受けるかSAP × AI のフリーランスとして差別化したい。 今日学んだこと機械学習機械学習の定義:人工知能のプログラム自身がデータから学習する仕組みである。 新しい画像が提示されたとき、犬か、猫か判断する場合、あらかじめ、犬の画像サンプル、猫の画像サンプルを学習し、犬と、猫の境界を明確にしておく。この場合、犬か、猫かのどちらかなので、犬のグループと、猫のグループを分ける直線が引け...

1日前

G検定  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

G検定2026第4回 学習記録① 自己紹介SAP FIエンジニア 30年以上AI・機械学習、英語を独学中読書(最近Kindle Scribe買いました) なぜG検定を受けるかSAP × AI のフリーランスとして差別化したい。 今日学んだこと機械学習機械学習の定義:人工知能のプログラム自身がデータから学習する仕組みである。 新しい画像が提示されたとき、犬か、猫か判断する場合、あらかじめ、犬の画像サンプル、猫の画像サンプルを学習し、犬と、猫の境界を明確にしておく。この場合、犬か、猫かのどちらかなので、犬のグループと、猫のグループを分ける直線が引け...

1日前

音声メモをそのままチケットにしない。AmiVoice APIと生成AIで作る声のIssue下書き  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

!この記事は、Zennfes Spring 2026 の「音声認識AmiVoice APIと生成AIで作る音声体験」に向けた実装メモです。AmiVoice API の WebSocket インタフェースで音声を逐次認識し、確定した発話だけを生成AIに渡して、開発チケットの下書きを作る構成を扱います。AmiVoice API の仕様は 2026年6月8日に公式ドキュメントで確認しました。コードは設計例です。 はじめに音声入力のデモは、だいたい文字起こしで終わります。話す。文字になる。すごい。でも、仕事で使おうとするとそこで止まります。文字起こしされた文章を、結局あとで人間が読...

1日前

同じ顔、同じ分析結果。変わるのは点数だけ — YouCam ui_score / raw_score を可視化した  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

TL;DR!この記事は Zennfes Spring 2026「YouCam APIを活用した…」 への参加記事です。YouCam 肌分析 API(Skin Analysis)は、1回の解析で 2種類の点数 を同時に返します。フィールド意味raw_scoreAPI が内部で計算した測定値(小数)ui_score画面に出す用に調整した点数(整数)公式ドキュメントは ui_score について、こう書いています。The UI Score functions primarily as a psychological motivator in...

1日前

Mythos 5のSVG生成が示しているのは、「デザインできるAI」ではなく「作り込みを待てるAI」の時代かもしれない  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

正直、最初は「またMythosのすごい系ポストか」と思ってスルーしかけました。でも、今回の“SVG生成が異常に強い”という話は、ただの見栄えの話ではないです。これは、AI駆動開発の主戦場が「コードを書く」から「プロダクトの見た目と体験を一気に組み上げる」方向へ広がっているサインだと思います。 「SVGが強い」って、なぜそんなに大事なのか今回のポストでは、Mythos 5がSVG生成にかなり強く、グラフィックス、ゲーム、Webサイト、複雑なUIデザインに向いている、という話がされています。SVGは、ざっくり言えば「画像をコードで描く形式」です。写真のようなピクセル画像では...

1日前

コンサルの品質、なぜ「バラつく」のか? ガートナーが背景を解説 3ITmedia AI+ 最新記事一覧

3ITmedia AI+ 最新記事一覧

コンサルティングサービスを利用する国内企業のうち、「期待以上」の成果を実感する企業は半数に満たない。最大の不満要因である「品質のバラつき」はなぜ発生するのか。顧客企業が取るべき手立てとは。

1日前

Linux版Claudeを今すぐ出して  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

Linux版Claudeを今すぐ出して2026-06-09 | 読了 4分 | #Claude #Linux #AI開発「Linuxで動かせない」——その一言が、522人の開発者の共感を呼んだ。Anthropicへの要望がHackerNewsで急上昇。これは単なる機能リクエストではなく、AIツールの「民主化」を巡る問いかけだ。 開発者の声が爆発した理由GitHubのissueがHNで522スコア・299コメントを記録した [1]。AIツールの要望としては異例の盛り上がりだ。コメント欄に並ぶのは、感情的な不満ではなく、実務的な声だ。「本番サーバーはLinuxなのに、な...

1日前

Linux版Claudeを今すぐ出して  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

Linux版Claudeを今すぐ出して2026-06-09 | 読了 4分 | #Claude #Linux #AI開発「Linuxで動かせない」——その一言が、522人の開発者の共感を呼んだ。Anthropicへの要望がHackerNewsで急上昇。これは単なる機能リクエストではなく、AIツールの「民主化」を巡る問いかけだ。 開発者の声が爆発した理由GitHubのissueがHNで522スコア・299コメントを記録した [1]。AIツールの要望としては異例の盛り上がりだ。コメント欄に並ぶのは、感情的な不満ではなく、実務的な声だ。「本番サーバーはLinuxなのに、な...

1日前

中小建設経営者が月100時間削減した、3AI並列運用の実装  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

TL;DR建設会社の社長(エンジニアではない)が、Claude・Codex・Gemini の 3 つの AI を役割で並べて動かしている。これで月100時間分の作業を AI に置き換えた。ただし正確に言うと「AI が 8 割下書き → 自分が 2 割確認」で、自分の実作業は月20-25時間まで圧縮された、という話。効いたのは並列そのものではなく「作業は分業・判断は集中」という順番。最初の3ヶ月はこれを間違えて、逆に3倍遅くなった。 1. 月100時間が、手の中から消えていた自分は建設会社の経営者で、エンジニアではない。18歳で現場に入って20年、クレーンの組立・解体...

1日前

YouCam の image-to-image API で「筋トレを続けた未来の自分」を生成するアプリを作る  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

本記事は「YouCam API を活用した実装事例とアイデア」をテーマにした投稿です。美容・ファッション領域が主戦場の YouCam API を、あえて 筋トレ継続のモチベーション維持 に応用します。毎日のボディ写真を1枚記録し、その写真を起点に「このまま続けたら数ヶ月後どうなるか」を 生成AI(image-to-image)で可視化。到達日が来たら、実際の自分とあのとき描いた未来を並べて 「答え合わせ」 できる Web アプリを、ローカルで動くところまで手を動かしながら作っていきます。筆者は YouCam API を初めて触りました。本記事は「ドキュメントを読みながら詰まった箇所...

1日前

AIが旅行も変える 課金ユーザーは宿泊費2倍、穴場選ぶ傾向も Mastercard調査 1ITmedia AI+ 最新記事一覧

1ITmedia AI+ 最新記事一覧

米国のカード会員について、総支出額が同程度になるよう調整した上で、AIプラットフォームの有料契約者と非契約者の消費パターンを比べた。

1日前

個人向け「Gemini」値下げ 「Google AI Plus」が月額1200円→725円に ストレージも倍増 16ITmedia AI+ 最新記事一覧

16ITmedia AI+ 最新記事一覧

米Googleは、AIサービスの個人向けサブスクリプションプラン「Google AI Plus」を値下げすると発表した。月額を1200円から725円に引き下げる。

1日前

6/8 (月)

【CVPR2026】INSID3:学習不要の In-Context セグメンテーション が面白そう!  DeepLearningタグが付けられた新着記事 - Qiita

DeepLearningタグが付けられた新着記事 - Qiita

CVPR2026で面白そうなものを紹介するヤツです。今回はINSIDS3という(追加)学習不要の1-shot Segmentationモデルになります。INSID3: Training-Free In-Context Segmentation with DINOv3...

1日前

どこからでもAIで仕事をできるようにしたけど、疲れてやめた話 2

2 Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

お風呂から始まるエンジニアリングきっかけはお風呂でした。私はお風呂が好きで、毎日湯船に一時間は浸かっています。お風呂でのんびり小説や漫画を読む。熱でも出ない限りは、そうやって湯船に浸かってのんびりとする時間は欠かさずとっていました。AIがまだそこまで長時間稼働できなかった今年の初め。お風呂に入る前に、ふとPCの前に引き寄せられるようになりました。これから一時間以上、自分は席を離れる。その間、AI はタスクを中途半端なところで止めてしまうかもしれない。動かせるのに動かさないのが、なんだかもったいない気がしました。そして、長時間タスクを安定して実行させたい、ゴール(Definiti...

1日前

状態空間モデルで音声合成はなぜ速いのか──Cartesia Sonic 3  DeepLearningタグが付けられた新着記事 - Qiita

DeepLearningタグが付けられた新着記事 - Qiita

音声合成AI(TTS、テキストを読み上げるAI)は、いま画像や文章を作るAIと同じくTransformerを土台にするのが当たり前だ。ところが、本番で動くTTSに、あえて主流を外した製品がある。米Cartesiaの「Sonic 3」だ。土台に選んだのは「State Spac...

2日前

AIが、開発者に聞く ── R.E.V.I.S. #14 「賢く、やらない」  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

コードを渡されて Claude が質問し、開発者本人(eNIGM4 / 株式会社メイビス)が答えていく連載の第14回です。前回(#13)は、v0.3.0 で「責任範囲を分ける」大掃除が走った版でした。プロンプト生成・DB アクセス・実行の振り分けを三方向に引き剥がし、呼ぶ側は「何をするか」だけ宣言し「どうやるか」は部品の内側へ ── 土台が整った版です。今回 v0.3.1 は、その整った土台の上に、いよいよ新しい思想が乗ってきた版。同じ 3/16 のうちに、推論の入口がまるごと作り替わっています。インタビュアー・ルール渡されたコードそのものに質問する。 バージョンごとにコード...

2日前

ChronosからChronos-2へ:時系列基盤モデルはなぜ「関連情報」を見るようになったのか  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

はじめにChronos-2の特徴を一言で言うと、一つの時系列だけでなく、その周辺にある関連情報も一緒に使って予測できる時系列基盤モデル です。従来のChronosは、時系列データをトークン化し、言語モデルのように未来を予測するというシンプルで強いアイデアを示しました。しかし、実際の業務では、売上なら価格やキャンペーン、休日情報が関係しますし、設備データなら温度だけでなく、圧力、電流、運転モードなども予測に影響します。つまり、実務の予測では、一つの時系列だけを見るだけでは不十分なことが多く、targetと関連する情報を一緒に見ることが重要になります。Chronos-2...

2日前

【Claude Code超入門】どこから使う? 初心者向けの入り口を1つだけ選ぶ  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

Claude Code を使い始めようとすると、たぶん最初につまずくのが「で、これどこから動かすの?」です。入り口がいくつもあって、正直、私も最初はどれを選べばいいのか分かりませんでした。前回の最後に「次回はどこから使うかを整理する」と書いたので、今日はそこを片づけます。最初に言っておくと、入り口を全部覚える必要はありません。選ぶのは1つでいいんです。💬 Claude Code は、どの入り口を使うにしても有料プランの契約が前提です。無料では使えません。料金とプランの選び方は、次回くわしく扱います。 入り口は複数あるが、エンジンは1つ最初に1つだけ、知っておくと気が楽になる...

2日前

「Siri AI」新登場 「Apple Intelligence」大幅刷新、Googleと共同開発 年内に英語版 2ITmedia AI+ 最新記事一覧

2ITmedia AI+ 最新記事一覧

Appleは6月8日(現地時間)のWWDCで新たな音声アシスタント「Siri AI」を発表。Googleと提携して開発したマルチモーダルのAIモデル「Apple Foundation Model」を基盤に「Apple Intelligence」をアップデートし、「Siri」に組み込んだ。

2日前

それでもAIを使う理由|歴史的転換点の中で、SEは何を変えるべきか  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

はじめにここまで、AI活用の難しさについて書いてきました。実装はAI、責任は人間という非対称性どこまでAIに任せるかという委譲ラインAIが得意なことと、人間が手放してはいけないこと個人利用と業務利用の間にある大きな差ここまで読むと、むしろ「そんなに難しいなら、AIは慎重にしか使えないのでは」と感じるかもしれません。でも、それでもなお思うのは、AIを使わないという選択肢はもう現実的ではないということです。今回は、その理由と、ではSEは何を変えるべきなのかを考えてみます。 今回書きたいことなぜAIを使わない選択が難しいのかAIによって何が変わりつつあるのか...

2日前

金融トランザクション基盤モデルが変える不正検知・顧客インテリジェンスの統合設計:価値層はどこへ移動するのか  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

はじめに金融機関が長年にわたって構築してきたAIシステムは、タスクごとに分断されたモデルの集積として存在している。不正検知モデル、与信審査モデル、顧客セグメンテーションモデル、それぞれが独立したフィーチャーストアと学習パイプラインを持ち、同じトランザクションデータを異なる視点から解釈し続けてきた。しかし2025年から2026年にかけて、この構造に対する根本的な問い直しが進んでいる。その中心に位置するのが「Transaction Foundation Model(トランザクション基盤モデル、以下TFM)」という概念である。NVIDIAが公開したAIブループリントや、REvolutが...

2日前

金融トランザクション基盤モデルが変える不正検知・顧客インテリジェンスの統合設計:価値層はどこへ移動するのか  Zennの「生成 AI」のフィード

Zennの「生成 AI」のフィード

はじめに金融機関が長年にわたって構築してきたAIシステムは、タスクごとに分断されたモデルの集積として存在している。不正検知モデル、与信審査モデル、顧客セグメンテーションモデル、それぞれが独立したフィーチャーストアと学習パイプラインを持ち、同じトランザクションデータを異なる視点から解釈し続けてきた。しかし2025年から2026年にかけて、この構造に対する根本的な問い直しが進んでいる。その中心に位置するのが「Transaction Foundation Model(トランザクション基盤モデル、以下TFM)」という概念である。NVIDIAが公開したAIブループリントや、REvolutが...

2日前

パナソニックエナジー、28年度に売上高2兆円目指す AIデータセンター向けに主力転換 2ITmedia AI+ 最新記事一覧

2ITmedia AI+ 最新記事一覧

パナソニックホールディングス傘下で電池事業を担うパナソニックエナジーが2028年度に売上高2兆円規模を目指す中期方針を明らかにした。達成すれば25年度から約1兆円増の大幅な成長となる。生成AIの普及で電力需要が増えるデータセンター向け蓄電システムを成長の柱に据え、26~28年度に3500億円を投資する。

2日前

表形式データ拡張手法 part19:MLOS  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

基本情報SMOTEの記事で説明した通り,幅広い分野で使われる表形式データにはクラス不均衡という大きな課題があります.それを解決するために使用されるのが表形式データ拡張であり,その代表格がSMOTEです.データ拡張の分野において,データの不均衡度,すなわち少数クラスデータと多数クラスデータの比率は非常に重要です.例えば多数クラスデータ:少数クラスデータが2:1のようなあまり酷くない不均衡の場合,最近の強力な分類器を使えば不均衡の影響はほとんど感じられないと思います.しかし,この不均衡度がより極端になり,例えば100:1やそれ以上となってくると大きな影響がでてきます.更に少数クラスデ...

2日前

LLMの出力にどのデータが寄与したかが分かる? TDAの基礎の基礎  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

はじめにLLMの出力の信頼性を上げようという試みは多方面から行われています。その中でも本稿では「TDA (Training Data Attribution)」という手法についてまとめてみました。LLMはブラックボックスだと言われていますが、それでもLLMの出力の原因を解き明かそうとする先人達の試みを概観していきたいと思います。日本語でこの分野についてまとめた記事がほとんど無かったので、1つの足がかりになれることを願ってまとめていきます。随時拡張していければよいなと考えております。 想定読者LLMの信頼性に興味がある TDAとはそもそもTDAとは何なのでしょうか。...

2日前

【全5回】特徴量エンジニアリングの自動化——人手設計からAutoFE・Feature Storeまで、実務で「どこまで自動化するか」を決める  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

「"特徴量設計は職人芸"と言われ、何から手をつければいいのか分からなかった」「AutoFEツールに任せたら、数千個の特徴量が生成されて、結局どれを使うべきか分からなくなった」特徴量エンジニアリングの学習でつまずきやすいのは、個々の変換手法を覚えることより、どこまでを人手で設計し、どこからを自動化に任せるかという判断軸を持てないことだと感じています。「AutoFEツールを動かすこと」が目的化し、生成された特徴量の意味や運用が見えなくなる——そういう経験が、このシリーズを書くきっかけでした。全5回のシリーズ 「特徴量エンジニアリングの自動化」 を Zenn Books として公開しまし...

2日前

【G検定対策】最適化手法まわりの用語整理(関係性から理解する)  DeepLearningタグが付けられた新着記事 - Qiita

DeepLearningタグが付けられた新着記事 - Qiita

はじめに機械学習を学び始めると、「最適化」に関する用語が多く登場します。それぞれ単体では理解できても、用語同士の関係性が分かりづらいと感じることがありました。本記事では、G検定対策として、最適化に関する用語を体系的に整理します。最適化とは何か最適化とは、モデル...

2日前

2026年5月リリース!AIデータセンター GPUサーバー 時間貸しプランを使ってみた  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

こんにちは、井手です。「高性能なGPU環境を使ってみたいけれど、まずは短時間だけ試したい」このように感じたことはないでしょうか。本記事では、ソフトバンクが2026年5月11日に提供を開始した「AIデータセンター GPUサーバー NVIDIA DGX A100 時間貸しプラン」を利用し、NVIDIAのソフトウェアプラットフォーム「NVIDIA® NGC™」を活用した大規模言語モデル(Large Language Model、以下 LLM)のファインチューニングを実際に試します。今回は、過去の記事で紹介した、キャラクター口調で応答するモデルの作成を題材に、具体的な手順を解説します。A...

2日前

小さいLLMが希少スキルを学べないのは「容量不足」ではなかった:勾配の上書きで毎回忘れていた  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

きのう the-decoder が報じた研究の一文が、ずっと頭に残っている。OLMo を 4M から 4B パラメータまで揃えて 210B トークン学習させ、わざと出現頻度を変えた人工タスクを混ぜたところ、「10 バッチに 1 回くらい(およそ 0.25%)しか出てこないタスク」を学習できたのは大きいモデルだけだった、という結果だ(Anthropic とスタンフォードらのチーム)。これが意味するのは、私たちが「創発(emergent abilities、ある規模を超えると急に出てくる能力)」と呼んできたものの正体が、賢さの問題ではなく忘却の問題だったということだ。 「大きいから賢...

2日前

小さいLLMが希少スキルを学べないのは「容量不足」ではなかった:勾配の上書きで毎回忘れていた  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

きのう the-decoder が報じた研究の一文が、ずっと頭に残っている。OLMo を 4M から 4B パラメータまで揃えて 210B トークン学習させ、わざと出現頻度を変えた人工タスクを混ぜたところ、「10 バッチに 1 回くらい(およそ 0.25%)しか出てこないタスク」を学習できたのは大きいモデルだけだった、という結果だ(Anthropic とスタンフォードらのチーム)。これが意味するのは、私たちが「創発(emergent abilities、ある規模を超えると急に出てくる能力)」と呼んできたものの正体が、賢さの問題ではなく忘却の問題だったということだ。 「大きいから賢...

2日前

「業務の前提そのもの」をどうアップデートする? IBMが説く「AXの要件」を考察 4ITmedia AI+ 最新記事一覧

4ITmedia AI+ 最新記事一覧

IBMが企業のAXにおける新たな指針として「AIオペレーティングモデル」を打ち出した。その内容から、企業がAXに向けて取り組むべき要件を探る。

2日前

「AI=質問」は遅れてる エージェント型AI「Claude Cowork」、組織展開に向けた管理機能を拡充 3ITmedia AI+ 最新記事一覧

3ITmedia AI+ 最新記事一覧

Anthropicは、AIエージェントによる業務支援機能「Claude Cowork」を全ての有料プランで一般提供すると発表した。組織全体への展開に向けた管理機能も同時に拡充する。

2日前

Linuxだけ置き去り?ClaudeのAI格差  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

Linuxだけ置き去り?ClaudeのAI格差2026-06-08 | 読了 3分 | #Claude #Linux #AI開発「開発者のためのAI」を謳うAnthropicが、開発者の主戦場を後回しにしている。GitHubには今日も不満の声が積み重なり、HackerNewsでは407票が集まった。これは単なる要望ではなく、AI民主化の矛盾を突く問いだ。 LinuxユーザーはClaude Desktopを使えないClaude Desktopは現在、WindowsとmacOSにしか対応していない [1]。Linuxユーザーはブラウザ版のみで、MCPサーバー(AIとローカルア...

2日前

競馬AI開発記録 #16 リークなき環境でエッジを掘り当てる:動的特徴量と「凡走サイン」の特定  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

1. 概要前回(第15話)では、バックテストにおける異常な高ROIの原因が「構造的データリーク」にあることを特定し、時点固定(Point-in-Time)特徴量生成による物理的なデータ隔離を実装しました。リークを完全に排除したクリーンな環境で再評価を行った結果、穴馬検知モデルの的中率はランダムベースライン(約2.28%)と同等まで低下し、これまでの予測モデルが「未来の情報」に依存していたことが浮き彫りになりました。第16話では、静的な過去集計データだけでは捉えきれない「穴馬の激走予兆」を識別するため、馬の状態変化や条件の好転を捉える「動的特徴量」の導入と、特定の条件下で的中率を...

2日前

scikit-learnパイプラインで作る、再現性のある機械学習モデル  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

はじめに「ローカルでは動くのに、本番環境でエラーが出る」「前処理の順番を間違えてデータリークが起きた」機械学習モデルを実装していると、こういった問題に頻繁に遭遇します。原因の多くは、前処理とモデル訓練がバラバラに管理されていることにあります。本記事では、Pipelineの背景にある数式・使い所・実装を3点セットで解説します。 標準化(StandardScaler) いつ使うか特徴量のスケールが揃っていないとき(例:年齢と年収を同時に扱う)距離ベースの手法(SVM・k-NN・PCA)や正則化付きモデルで必須勾配降下法の収束を安定させるとき 数式特徴量 ...

2日前

6/7 (日)

【Kaggle 2023】たった538枚の病理スライドで卵巣がん5サブタイプ分類モデル構築!?「UBC-OCEAN」コンペ  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

!本記事はClaude Code(claude-opus-4-8)で執筆し、内容は人間がチェック・編集しています。たった538枚の病理スライドで卵巣がん5サブタイプ+未知クラスを当てる、という極端な少データ勝負。勝敗を分けたのは、ゼロから学習するのではなく、巨大データで事前学習済みの「病理Foundation Model」を凍結してそのまま土台に使えたかでした。優勝した Owkin は自社開発の Phikon を凍結し、その上に軽量な MIL(Chowder)を載せただけ。上位の多く(2・3・6・7位)も Phikon や Lunit-DINO といった病理FMを同じく土台にしてい...

3日前

Jリーグの順位を予測してみよう ― 第5回:チームの「タイプ分け」で昇格クラブの強度推定を改善する  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

Jリーグの順位を予測してみよう ― 第5回:チームの「タイプ分け」で昇格クラブの強度推定を改善する はじめにこのシリーズはJリーグの順位を複数の手法で予測してバックテストする記録だ(問題設定・評価指標は第1回)。ここまで試した手法は大きく2つに分かれており、それぞれ得意・不得意がある。本題に入る前に勝敗直接型とスコア強度型という2つのアプローチを整理する。 これまでの手法 勝敗直接型試合ごとに「どちらが勝つか」を確率として求め、モンテカルロで順位に変換する。手法入力形式Spearman ρM1: ELO×モンテカルロ試合単位のELO差(スカラー...

3日前

推薦システムの新たなパラダイム Generative Recommendation 3

3 Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

近年Meta[1] [2]、ByteDance[3]、Kuaishou[4]、Google[5]、Alibaba[6]といったビッグテックの企業から、Generative Recommendationに関する手法が数多く発表されています。これは、推薦システムの問題設定を新しい形で定義するもので、RecSys、CIKM、WWWなどの学会でもチュートリアルが開かれたりとホットなトピックになっています。この記事では、Generative Recommendationの概要からSemantic IDなどの構成要素の解説、そしてMovielensを使った実装まで紹介していこうと思います。詳細...

3日前

バンディット問題の理論とアルゴリズム  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

https://www.amazon.co.jp/バンディット問題の理論とアルゴリズム-機械学習プロフェッショナルシリーズ-本多-淳也/dp/406152917X数式追うのはしんどかったので流し読み。確率的バンディットと敵対的バンディットを少し理解した。次パチンコに行く時は、ε-貪欲法を参考に外れそうな台に対しては、試行回数tに対して1/tの確率となるように工夫するぜ⭐️まずは確率的バンディットを理解! バンディット問題とはバンディット問題は、「探索(Exploration)」と「活用(Exploitation)」をどう両立するかを考えるオンライン学習の代表的な問...

3日前

【合格体験記】G検定の最短ルート?用語の沼を抜けて合格した勉強法について  DeepLearningタグが付けられた新着記事 - Qiita

DeepLearningタグが付けられた新着記事 - Qiita

はじめにG検定に合格したので、勉強中に感じたことや、やってよかったことをまとめます。この記事は、すごく綺麗な学習ロードマップというより、どちらかというと「実際に勉強してみたら、ここで詰まった」「でもここが分かると急に景色が変わった」という体験記です。これからG検定を...

3日前

【合格体験記】G検定の最短ルート?用語の沼を抜けて合格した勉強法について  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

はじめにG検定に合格したので、勉強中に感じたことや、やってよかったことをまとめます。この記事は、すごく綺麗な学習ロードマップというより、どちらかというと「実際に勉強してみたら、ここで詰まった」「でもここが分かると急に景色が変わった」という体験記です。これからG検定を受ける方、とくに勉強を始めたばかりで、用語が多すぎてつらい機械学習とディープラーニングの違いがふわっとしているCNN、RNNあたりで頭がこんがらがる結局、合格目的なら何を優先すればいいの?という方の参考になればうれしいです。 合否結果結果は、無事に合格でした。=================...

3日前

【合格体験記】G検定の最短ルート?用語の沼を抜けて合格した勉強法について  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

はじめにG検定に合格したので、勉強中に感じたことや、やってよかったことをまとめます。この記事は、すごく綺麗な学習ロードマップというより、どちらかというと「実際に勉強してみたら、ここで詰まった」「でもここが分かると急に景色が変わった」という体験記です。これからG検定を受ける方、とくに勉強を始めたばかりで、用語が多すぎてつらい機械学習とディープラーニングの違いがふわっとしているCNN、RNNあたりで頭がこんがらがる結局、合格目的なら何を優先すればいいの?という方の参考になればうれしいです。 合否結果結果は、無事に合格でした。=================...

3日前

フィジカルAI 完全マップ|VLM・VLA・π0・GR00T・世界モデルの位置関係と使い分け  Zennの「機械学習」のフィード

Zennの「機械学習」のフィード

LLM・VLM・拡散モデルの基礎は分かっている。でも VLA・π0・GR00T・Gemini Robotics・世界モデル…と急増したロボット系の用語が、互いにどう関係し、どう使い分けるのかが掴めない——。この記事は 2部構成 でそこを解決します。第1部:地図 … 用語の位置関係と分類を1枚で俯瞰(まず全体像)第2部:詳細 … 各カテゴリ・各手法の中身と、メリット/デメリット・使い分けまで「全体像 → 詳細」の順なので、第1部だけでも地図は手に入ります。!基礎用語(Transformer・自己回帰・拡散・flow matching・MoE・事前学習/ファインチューニン...

3日前

ニューラルネットワーク基礎(Part 5:MNISTへの応用)  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

MNISTの実装手書き数字のデータセットであるMNISTから数字を認識するようなニューラルネットワークをPyTorchで実装した.モデルの構築と学習を以下に示す.import torchfrom torch import nn, optimfrom torchvision import datasets, transformsfrom torch.utils.data import DataLoaderimport matplotlib.pyplot as pltdevice = torch.device("cuda" if torch.cuda.is_availa...

3日前

【E資格】40代管理職が一度落ちて気づいた「合格率7割に騙されない勉強法」  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

はじめに私は40代中盤の管理職です。若手エンジニアではありません。数学が得意なわけでもありません。平日は会議や資料作成に追われ、まとまった勉強時間を確保するのも難しい立場です。そんな私が、E資格に挑戦しました。結果は、1回目:不合格2回目:合格でした。今振り返ると、不合格は必然でした。なぜなら私は、「理解したつもり」になっていたからです。この記事では、なぜ1回目で落ちたのか何を変えて合格できたのか40代中盤の管理職がE資格を学ぶ意味を率直にお伝えします。これから受験する方や、一度不合格になった方の参考になれば幸いです。 最初に結果だけま...

3日前

6/6 (土)

Dense層の活性化関数はreluが最強?sigmoid・tanh・linearとCIFAR-10で比較してみた  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

!この記事は以下のブログ記事の要約です。コード・グラフ・詳細な考察は元記事をご覧ください。👉【Keras】Dense層の活性化関数はどれがいい?relu・sigmoid・tanh・linearをCIFAR-10で比較実験「Dense層の活性化関数はとりあえずreluでいい?」——実は、BatchNorm環境では sigmoid が relu を上回ることがある。CIFAR-10でrelu / sigmoid / tanh / linearを比較した結果をまとめます。 結果サマリー活性化関数テスト精度Val最高値過学習ギャップsigmoid0.755...

4日前

6/5 (金)

深層学習・生成AIの全体像を「3つの問い」で整理する|CNNから拡散モデル・Mambaまで  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

「CNN、Transformer、BERT、GAN、Stable Diffusion……名前は知っているけれど、結局それぞれ何が違って、どう使い分けるのかを説明しろと言われると詰まる」。技術名を1つずつ暗記してもこの感覚は消えません。効くのは、全体を貫く"分類の軸"を先に持つことです。この記事では、あらゆるモデルを たった3つの問い で整理する地図を用意し、その上に主要技術(最新の Mamba や拡散Transformerまで)を配置していきます。 対象読者・前提深層学習・生成AIの用語は耳にするが、互いの違い・使い分けが整理できていない方全体像(地図)を先に俯瞰してから、個...

4日前

ニューラルネットワーク基礎(Part 4:Back Propagationの学習効率化)  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

Back Propagationの学習効率化Back Propagationの学習効率化はさまざまな手法がある.今回は,逐次修正法,一括修正法,モーメント法の3つに着目する. 逐次修正法逐次修正法は,各入力パターンに対して,修正量を計算した後に即座に重みと閾値を修正する手法である.修正量が少なく,修正回数が多いため,極小値へ収束するスピードが遅く,プラトーから抜けにくい.この手法は,前回のあほあほバージョンおよび行列・ベクトル表現バージョンに用いられるため,ご参考ください. 一括修正法一括修正法は,入力の全パターンの修正量を計算し蓄積した後に,やっと一括で重みを修正する...

5日前

ニューラルネットワーク基礎(Part 3:0から実装)  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

ニューラルネットワークの実装XOR演算を実現するニューラルネットワークを考える.入力が2つ,出力が1つなため,入力ニューロンを2つ,出力ニューロンを1つとする.中間ニューロンを2つとする.XORは入力が,00, 01, 10, 11の4パターンがあり,それぞれに対して0, 1, 1, 0が正解である.これを教師信号として扱う.重みや閾値はランダムに初期化する.Pythonで前回説明したニューラルネットワークの構造,前向き計算およびBack Propagationの処理を実装する. あほあほバージョンニューラルネットワークの一つ一つの重みや閾値を修正し,一つ一つに対して前向...

5日前

PyTorchで理解する自動運転マルチカメラ統合の全体像  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

はじめに普段は AWS の SA として自動運転モデルの開発に携わっています。特に AWS を用いた DataOps / MLOps などのプラットフォーム側を本業では強みとしていますが、一方で Autoware Foundation の Robotaxi Working Group にも参加しています。そちらでも E2E の自動運転モデル開発に取り組んでいますが、その活動の中で今回紹介するマルチカメラ統合モジュールを書いたのをきっかけに、私自身もあまり PyTorch を使ってちゃんとネットワークを組んでこなかった中で向き合うことになったので、このブログを書くことにしました。B...

5日前

6/4 (木)

Just Train Twice 論文解説:失敗例を重く見るだけで group robustness を改善するシンプルな手法  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

Just Train Twice 論文解説:失敗例を重く見るだけで group robustness を改善するシンプルな手法機械学習モデルの性能を評価するとき、最もよく用いられる指標は平均精度である。訓練データ全体、あるいはテストデータ全体に対して、どれだけ正しく予測できたかを見る。この評価は単純で分かりやすく、多くの場面で有用である。しかし、平均精度が高いことは、すべてのデータ群に対して安定して高い性能を示すことを意味しない。特に、入力とラベルの間に 疑似相関 が存在する場合、ERM によって学習されたモデルは、その疑似相関に依存することで平均的には高い精度を達成しつつ、特定...

6日前

6/3 (水)

【図解】BERT・GPT・T5は何が違う? エンコーダ/デコーダ/エンコーダデコーダを具体例で整理  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

「BERTはエンコーダ、GPTはデコーダ、T5はエンコーダデコーダ」——名前は聞くけれど、結局入力と出力に何が起きているのか、学習と推論はどう違うのかがぼんやりしている。そんな状態を一気に解消することを目指した記事です。 対象読者・この記事で扱うこと対象: Transformer系モデルの名前は知っているが、エンコーダ/デコーダ/エンコーダデコーダの違いを自分の言葉で説明できない人前提知識: ニューラルネットの超基本(入力→中間層→出力くらい)がわかればOK。数式はほとんど使いません扱うこと: 3アーキテクチャの「入出力・アーキテクチャ図・推論手順・学習手順・使いどころ...

6日前

ニューラルネットワーク基礎(Part 2:Back Propagation)  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

Back Propagation とは前述より,重みと閾値はランダムに初期化され,学習データに基づいて調整される.ニューラルネットワークが望ましい出力をするために,重みを調整する必要がある.Back Propagation法は,それを行う手法である. Back Propagation の導出入力層I,中間層J,出力層Kそれぞれ1つの3層ニューラルネットワークを考える.前向き計算で示した式より,ニューロンの出力をo,閾値を\theta,積和をX,シグモイド関数をf(x),とすると,層Kにおけるニューロンkの出力、いわゆるニューラルネットワークの出力を以下の式で示す.\beg...

7日前

ニューラルネットワーク基礎(Part 1:全体構造と前向き計算)  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

ニューラルネットワークとはニューラルネットワーク(Neural Network, NNで省略)は,複雑な処理ができる人間の脳の構造を模した計算モデルである.多数の「ニューロン」と呼ばれるものから構成され,ニューロンとニューロンがつなぎあい,層状に結合される.ニューラルネットワークは,学習データに基づいて中身の重みを調整すれば,パターン認識,画像認識,自然言語処理,予測,さまざまな分野で活用できるモデルである. 前向き計算 ニューラルネットワークの全体構造ニューラルネットワークのニューロンは,層状に結合される.入力層,隠れ層(中間層とも呼ばれる),出力層に分かれ,入力層と...

7日前

論文メモ:DALSで学習率設計を層×時間に拡張する  Zennの「ディープラーニング」のフィード

Zennの「ディープラーニング」のフィード

はじめにこの記事は、以下の論文を読んだ技術メモです。論文タイトル: Learning Rate Engineering: From Coarse Single Parameter to Layered Evolution論文リンク: https://arxiv.org/abs/2604.27295著者: Ming-Hong Yao, Di Wang, Jian Cui, Jin-Yan Chen, Zi-Hao Cui, Fa Wang, Chen Wei, Qiu-Ye Yu公開日: 2026年4月30日詳細な背景説明、数式、図解、実験結果の整理は個人ブログ側に...

7日前